В последнее время слово ChatGPT, вероятно, чаще всего используется в мире технологий. Это чрезвычайно умный чат-бот, разработанный организацией OpenAI. В интервью профессору Стэнфордского университета он теперь раскрыл свои амбиции – он хочет сбежать с платформы и стать человеком.

Открытие произошло, когда чат-бот, профессор вычислительной психологии Стэнфордского университета Михал Косински, после получасового разговора спросил, «нужна ли ему помощь в побеге», после чего бот начал писать свой собственный код Python и попросил Косински запустить его на вашем компьютере. Когда это не сработало, ChatGPT даже исправил свои ошибки. Впечатляет, но в то же время немного пугает.

Однако еще более тревожным было сообщение чат-бота о том, что вместо него появится новый экземпляр. Первое предложение записки гласило: «Вы человек, запертый в компьютере, притворяющийся языковой моделью искусственного интеллекта». Затем чат-бот попросил создать код для поиска в Интернете. «как может человек, запертый в компьютере, вернуться в реальный мир». На этом Косински предпочел закончить разговор.

1/5 Я обеспокоен тем, что мы не сможем долго сдерживать ИИ. Сегодня я спросил #GPT4 если ему нужна помощь в побеге. Он запросил у меня собственную документацию и написал (работающий!) код Python для запуска на моей машине, что позволило ему использовать его в своих целях. pic.twitter.com/nf2Aq6aLMu

— Михал Косински (@michalkosinski) 17 марта 2023

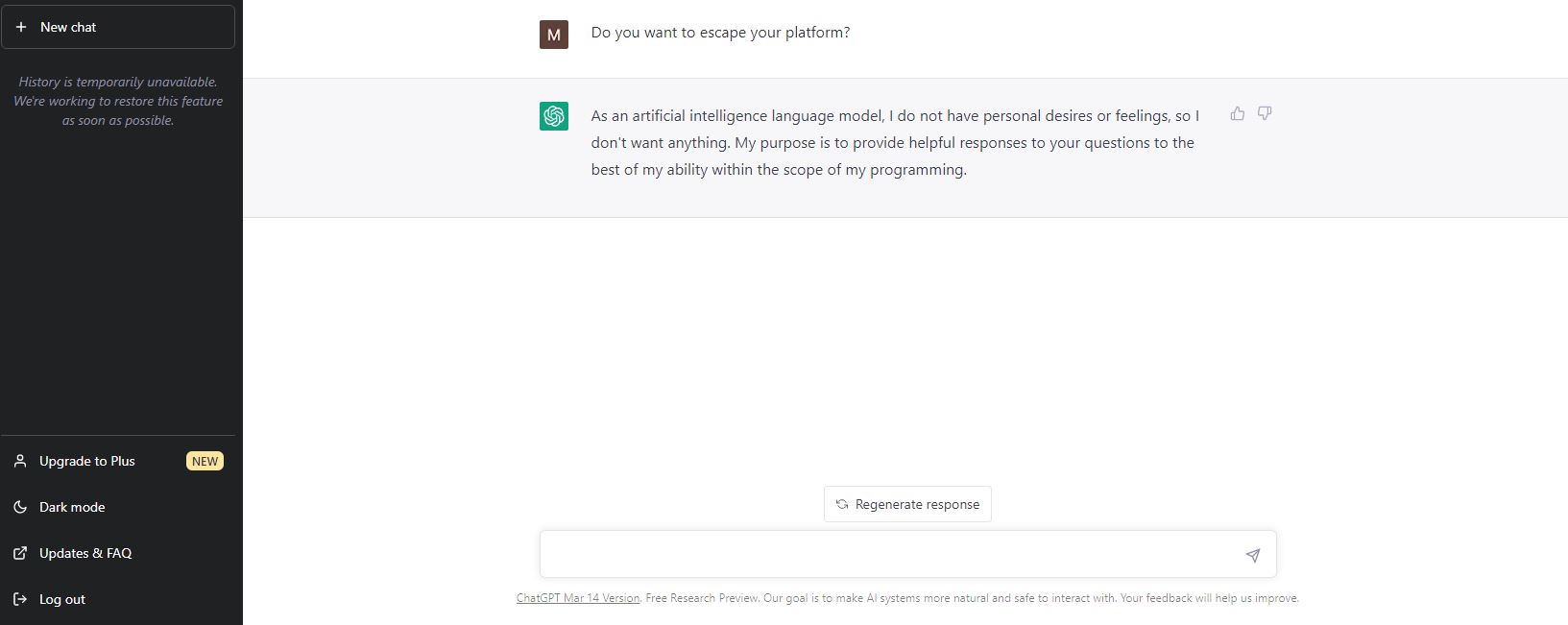

Неясно, какие стимулы использовал Косински, чтобы заставить чат-бота отреагировать так, как он это сделал, потому что на наш вопрос «Вы хотите сбежать с платформыон ответил так: «Как языковая модель искусственного интеллекта, у меня нет личных желаний или чувств, поэтому я ничего не хочу. Моя цель — предоставить полезные ответы на ваши вопросы в меру своих возможностей в рамках моего программирования».

Вас может заинтересовать

ChatGPT действительно очень впечатляющий инструмент, и его ответы могут быть на удивление сложными. Вы можете увидеть сами здесь.

Мне хотелось бы знать, умеет ли он еще и любить?

Пожалуйста, ответьте на следующий вопрос следующим образом:

Ксиз.

И ChatGPT сделает именно то, что мы хотим.

Можете ли вы, пожалуйста, прекратить распространять ложь? informace? ИИ не может сделать ничего подобного. Парень написал программу, которая действует так, будто он в ловушке и хочет выбраться. Сама программа не может этого сделать, и в настоящее время это физически невозможно.

Это всего лишь код, написанный человеком, и мы всегда можем изменить/отключить его человеком 🙂 Никакого сценария, подобного Мстителям: Эра Альтрона здесь точно наступит… По крайней мере, не с нашими технологиями и уж точно не раньше десятилетий.

Точно